问题都挺难的,只做了第一道题,二阶导数是softmax(Oj)+(softmax(Oj))**2

Y是独热向量,无论是哪一个Yj,只有Yj=1,其他都是0, 所以最后总和是1

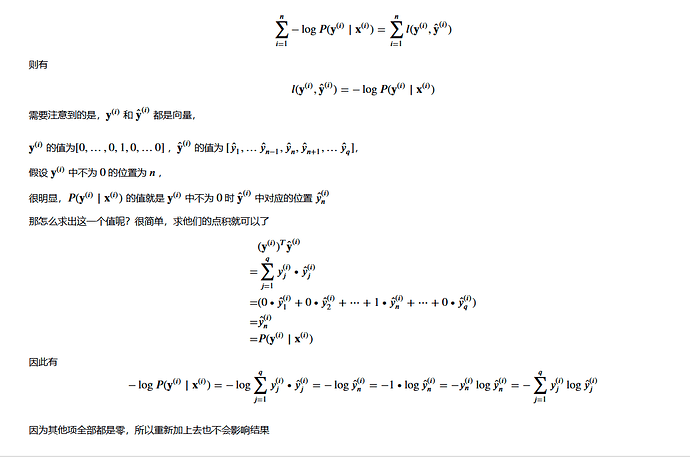

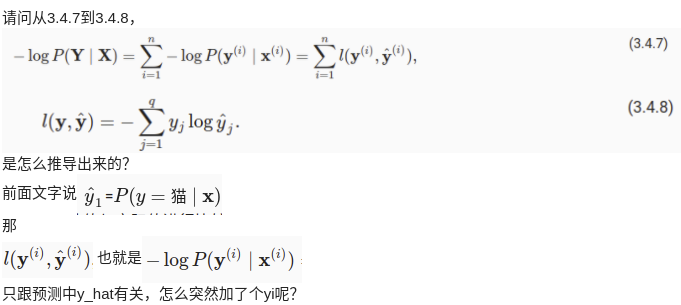

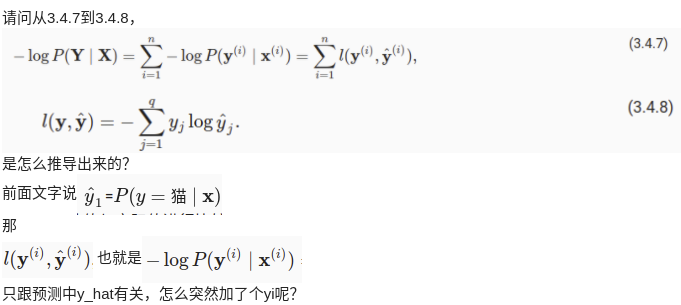

关于3.4.8, 不太明白等式右边yj×log(y^j)里面的第一个yj 怎么出来的

第一个yj 是真实y的独热编码的第j位 不是0 就是1

1 Like

老实说,感觉是机器翻译一样。。。

读起来非常生涩,估计是我水平不够= =

2 Likes

softmax(oj) * (1-softmax(oj))

5 Likes

报告一个错误,然而“我们”

9 Likes

请问如何理解“梯度是真是概率和预测概率的区别”这句话?

2 Likes

3.4.6中的公式log不写底数看起来好奇怪,感觉应该写ln,后面求导直接用的ln

1 Like

大佬,能看看你的过程吗,我不会做哈哈……

对咱俩的答案一样,没问题?这个还有20的限制吗

3.4.7建议解释下,看的一脸懵逼,下面的回复解释的也不太清晰

这一节分类标签,(鸡,猫,狗),上下文不一致。

请问“课后联系”的代码在哪里可以下载?或者文档也可以

2 Likes

这部分不少人读不懂,感觉不是很通透,希望解答下

2 Likes

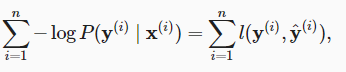

好棒!懂了。不过3.4.7中,请问为何 直接就相等了呀。不理解

直接就相等了呀。不理解

4 Likes

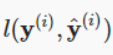

这是一种简略的写法,实际上是新定义了一个函数,也就是 ,使其等于

,使其等于![]()

5 Likes